AMD Ryzen AI 软件

概述

AMD Ryzen AI 软件包含多个工具和运行时库,用于在搭载 AMD Ryzen AI 技术的 PC1 上优化和部署 AI 推理。Ryzen AI 软件支持应用在内置于 AMD XDNA™ 架构的神经处理单元 (NPU)(Windows x86 处理器2上的第一个专用 AI 处理芯片)上运行,并支持集成 GPU (iGPU)。

开发流程

开发适用于 Ryzen AI 的 AI 应用可以简单地概括为 3 个步骤:

从预先训练的模型开始

在 PyTorch 或 TensorFlow 中使用预训练的模型作为起点。然后,将模型转换为与 Ryzen AI 工作流程兼容的 ONNX 格式。

量化

通过将模型参数从浮点转换为精度较低的类型(如 16 位或 8 位整数)来量化模型。ONNX 的 Vitis™ AI Quantizer 提供了易于使用的训练后量化 (PTQ) 流程。

部署模型

量化后,您的模型就可以部署在硬件上了。将 ONNX Runtime 与 C++ 或 Python API 配合使用来部署 AI 模型。ONNX Runtime 中包含的 Vitis AI 执行提供程序可优化工作负载,确保优异性能和更低的功耗。

开始使用 Ryzen AI 软件

立即体验

最新动态

- 1.7

- 1.6

- 1.5

- 1.4

- 1.3

- 1.2

- 1.1

- 1.0

1.7 版本亮点

- 新增架构:首次推出混合专家 (MoE) 架构 GPT‑OSS 模型和视觉语言模型 (Gemma‑3 4B)

- Stable Diffusion 已集成至 Ryzen AI 主安装程序,带来统一开发环境

- 如今,LLM 在 NPU 上可处理的最大上下文长度为 16K

- 与 RAI 1.6 相比,BF16 流水线的延迟降低了约 50%

1.6 版本亮点

- 提升了 BF16 编译器的性能并缩短了编译时间

- 新增整数编译器,支持通用非对称量化(A8W8、A16W8)

- 扩展了 NPU 专用模型集并优化了性能(在 KRK 和 GPT 上实现更高的每秒 token 数)

- 所有 LLM 的上下文长度增加到 4K

- 新增对全新 LLM 架构的支持:Phi-4 和 Qwen-3

- 为 SD 3.0/3.5 提供动态分辨率支持,并提升其他 SD 模型的性能,包括新增模型(SD2.1-v 768×768 文生图、SDXL-base 1024×1024 文生图模型)的性能

1.5 版本亮点

- 全新功能

- 利用 Stable Diffusion 流水线(SD 1.5、2.1、SDXL 及 3.0)生成图像。

- 集成语音转文本能力,支持 Zipformer 与 Whisper-base 模型。

- 通过抢占机制优化系统响应能力,为高优先级任务动态分配计算资源。

1.4 版本亮点

- 全新功能

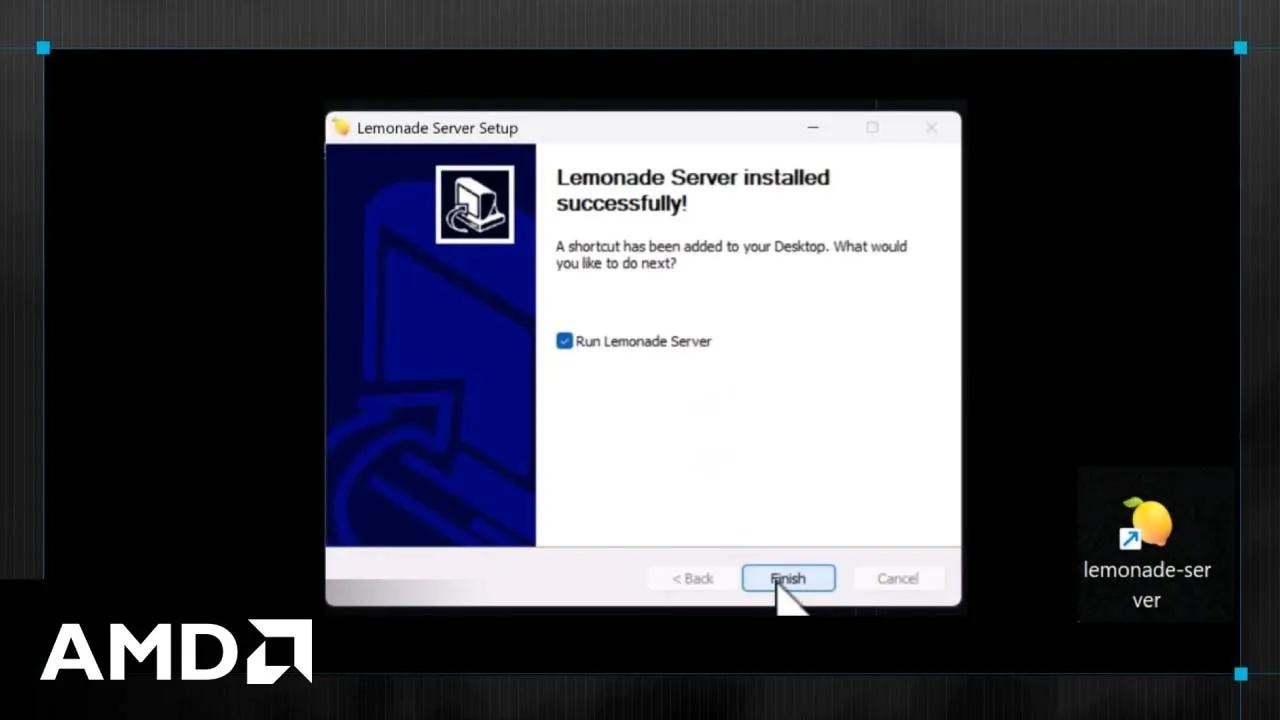

- Unified Installer 集成了 LLM 与通用模型流程(INT8、BF16),仅需单个发行包即可支持所有模型类型,带来无缝使用体验。

- 首次在 Windows 上支持针对 CNN 与 NLP 工作负载的 BF16 模型编译及量化。

- 支持 LLM OGA 流程,助力实现更轻松高效的 LLM 部署。

- 新增 LLM 模型支持

- DeepSeek-R1 蒸馏系列:Llama-8B、Qwen-1.5B、Qwen-7B

- Qwen2 系列:Qwen2-1.5B、Qwen2-7B

- Gemma2-2B

- AMD-OLMO-1B-SFT-DPO

- Codellama-7B、Mistral-7B 等

1.3 版本亮点

- 全新功能

- 针对 AMD 统一量化器“Quark”提供早期支持

- 支持混合精度数据类型和 Copilot+ 应用

- 更新了 CNN 分析工具

- 针对 ONNX-GenAI (OGA) 流程提供全新模型支持

- Llama2-7B-Chat/Meta-Llama-3.1-8B

- Phi-3-Mini-4K-Instruct/Phi-3.5-Mini-Instruct

- Mistral-7B-Instruct-v0.3

1.2 版本亮点

- 新的架构支持

- 支持 Strix (STX):AMD Ryzen AI 9 HX370 和 Ryzen AI 9 365 NPU

- 通过 Ryzen AI 软件统一支持集成 GPU (iGPU) 和 NPU

- 新增了抢先体验工具、模型和功能

- 适用于在 NPU 上运行的模型的新模型分析和可视化工具 (AI Analyzer)

- 新平台/NPU 检测管理工具 (xrt-smi)

- 在 PyTorch 和 ONNX 流中增加了多种 LLM 流支持

1.1 版本亮点

- 新模型支持:

- Llama 2 7B 支持 w4abf16(3 位和 4 位)量化(Beta 版)

- Whisper 基础版(抢先体验)

- 新的 EoU 工具和功能:

- RyzenAI-SW Rep 上的 CNN 基准测试工具

- 平台/NPU 检查和管理工具

1.0 版本亮点

- 模型支持

- 1,000 多个经过验证的 CNN 模型

- 在 NPU 上使用 PyTorch 和 ONNX 流运行 OPT-1.3B

- EoU 工具和功能

- 支持 ONNX PTQ(训练后量化)、PyTorch PTQ 和 QAT(量化感知训练)

- 支持 C++ 和 Python API 的 ONNX Runtime Vitis AI 执行提供程序

- 在 NPU 上自动安排最多 8 个同时进行的推理会话

开源项目

探索 AMD 开源工具,这些工具可助力开发者在多种硬件平台上高效分析、优化和部署 AI 模型。

加入 AMD AI 开发者计划

获取免费的 Cloud 信用值,与 AMD 工程师沟通交流,还能获得行业认可,参加会员专属抽奖活动,以及享受其他多种福利!

订阅 Ryzen AI 新闻

及时了解最新的产品发布、新闻和使用技巧。

附注

- Ryzen AI 技术兼容所有 AMD 锐龙 7040 系列处理器(锐龙 5 7540U 和锐龙 3 7440U 除外)。需要原始设备制造商支持。购买前请先咨询您的系统制造商是否支持相关功能。GD-220。

- 截至 2023 年 5 月,AMD 在 x86 Windows 处理器上创新实现专用 AI 引擎。“专用 AI 引擎”是指集成在 x86 处理器芯片内的专注于处理 AI 推理模型的 AI 引擎。有关更多详细信息,请访问:https://www.amd.com/zh-cn/technologies/xdna.html。PHX-3a

- 基于 AMD 在 2023 年 6 月 5 日进行的测试。评估电池续航能力的使用场景为:模拟 9 人参加的 Microsoft Teams 视频会议,测试中,锐龙 7940HS 处理器使用了 Windows Studio Effects,搭载 Ryzen AI 和集成 Radeon 显卡,实现 AI 增强的背景虚化和眼神校正功能。AMD 系统运行所用电量为 100% 至 > 5%,亮度为 150 尼特,电源模式设置为“节能”。系统配置:Razer Blade 14” 笔记本电脑,AMD 锐龙 9 7940HS 处理器,搭载 Ryzen AI、集成 AMD Radeon 显卡(22.40.03.24 驱动程序),16GB (8GBx2) LPDDR5,NVMe SSD 存储,Windows 11 Home 22H。 系统制造商可能会采用不同的配置,因而得到不同的结果。结果可能会有所不同。PHX-51

附注

- Ryzen AI 技术兼容所有 AMD 锐龙 7040 系列处理器(锐龙 5 7540U 和锐龙 3 7440U 除外)。需要原始设备制造商支持。购买前请先咨询您的系统制造商是否支持相关功能。GD-220。

- 截至 2023 年 5 月,AMD 在 x86 Windows 处理器上创新实现专用 AI 引擎。“专用 AI 引擎”是指集成在 x86 处理器芯片内的专注于处理 AI 推理模型的 AI 引擎。有关更多详细信息,请访问:https://www.amd.com/zh-cn/technologies/xdna.html。PHX-3a

- 基于 AMD 在 2023 年 6 月 5 日进行的测试。评估电池续航能力的使用场景为:模拟 9 人参加的 Microsoft Teams 视频会议,测试中,锐龙 7940HS 处理器使用了 Windows Studio Effects,搭载 Ryzen AI 和集成 Radeon 显卡,实现 AI 增强的背景虚化和眼神校正功能。AMD 系统运行所用电量为 100% 至 > 5%,亮度为 150 尼特,电源模式设置为“节能”。系统配置:Razer Blade 14” 笔记本电脑,AMD 锐龙 9 7940HS 处理器,搭载 Ryzen AI、集成 AMD Radeon 显卡(22.40.03.24 驱动程序),16GB (8GBx2) LPDDR5,NVMe SSD 存储,Windows 11 Home 22H。 系统制造商可能会采用不同的配置,因而得到不同的结果。结果可能会有所不同。PHX-51