通过共享 AI 算力加速创新

Nov 10, 2025

随着 AI 走出实验室,成为产品、服务与业务流程的核心,AI 工作负载运行和管理能力变得至关重要。然而,现有的基础设施与商业模式敏捷性不足,难以适配现代 AI 解决方案所需具备的动态、实时特性。

对企业而言,算力已成为不可或缺的战略资源,但与数据不同,算力无法轻易复制。算力必须被共享、调度,并具备高可靠性,尤其是在多个团队或公司需要在同一基础设施上运行大规模 AI 工作负载时。

解决 AI 多租户问题

多租户技术可解决这一难题,使多个用户、团队或组织能够共享同一套高性能基础设施(包括计算、存储和网络),同时让各自的数据与工作负载保持隔离。这正是云计算能够实现大规模运行的核心机制。

然而,高需求租户引发的资源争用会带来一系列严峻且复杂的问题。这会导致实时推理出现无法接受的高延迟,同时严重影响训练和微调任务的性能和吞吐量,造成任务延时完成。对于这些工作负载而言,每一个 GPU 周期都至关重要,每一个模型检查点的数据量都十分庞大,而每一秒的停机都会造成宝贵资源的浪费。

大多数企业最终只能为各自团队过度配置独立的 GPU 集群,不仅造成算力闲置浪费,还将创新禁锢在孤岛之中,进而导致算力资源利用率低下、创新节奏放缓,以及 AI 竞争成本持续攀升。

共享 AI 算力的新蓝图

为了解决 AI 多租户难题,AMD Silo AI 联合 TensorWave 与 Combient Group 推出了一种全新的 AI 算力共享式基础设施,旨在让大规模 AI 开发更快、更具成本效益,并实现更高水平的协作。

这种环境基于 TensorWave 上的 AMD Instinct 加速器构建,并由 AMD 资源管理器与 AMD AI 工作台提供支持,使多个组织能够可靠地共享高性能 GPU 基础设施。通过降低获取先进算力能力的门槛,同时构建繁荣的创新生态系统,这一模式可助力实现卓越创新。

“通过推进更加开放、协作的 AI 开发模式,这一计划正在让算力变得更易获取、更具弹性,也更高效。得益于算力民主化、可扩展基础设施和更快的价值实现周期,它让企业能够协同创新,开启 AI 新时代。”- TensorWave 联合创始人兼首席执行官 Darrick Horton。

面向 AI 的多租户计算基础设施

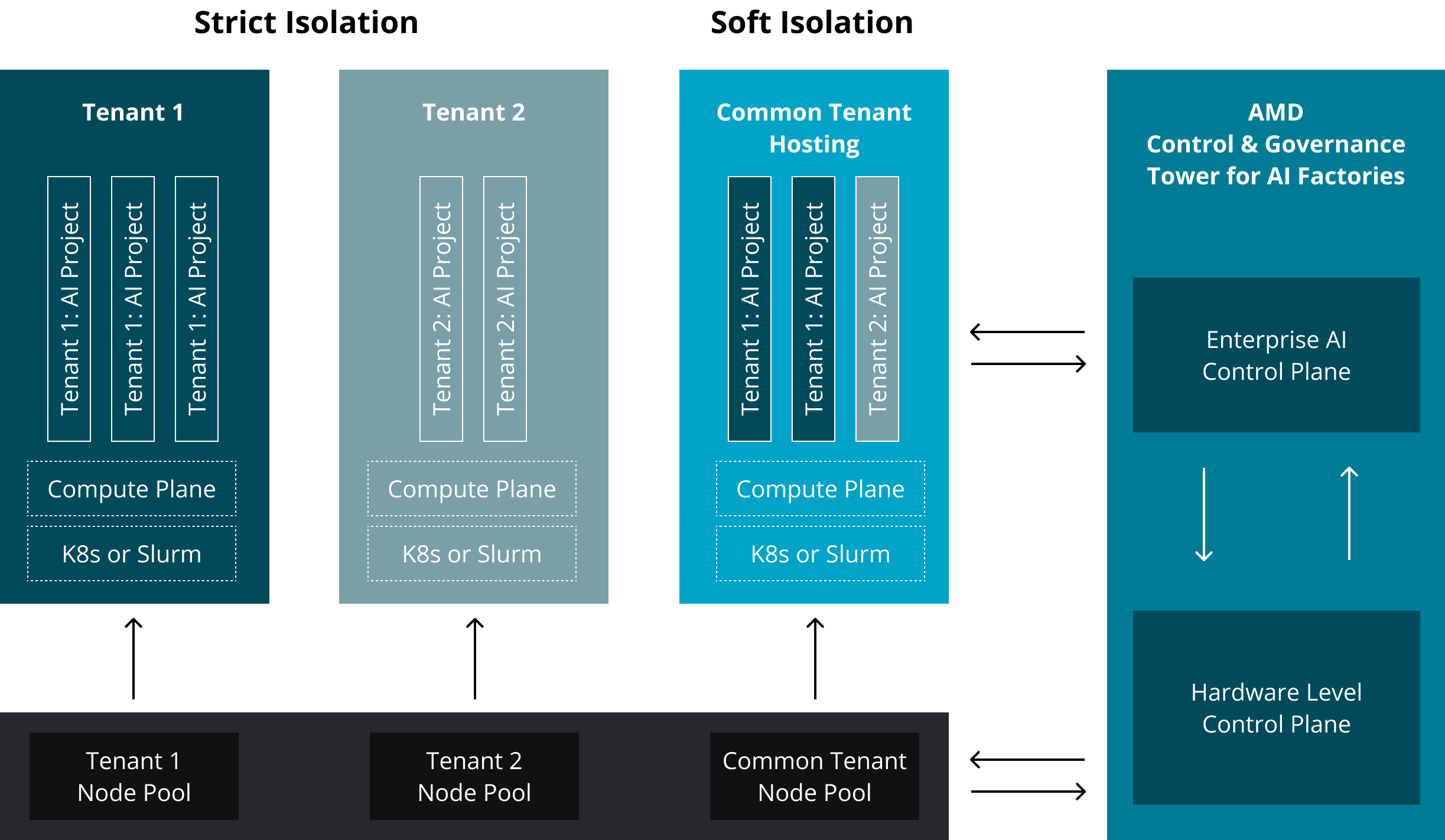

这种共享的多租户架构设计使多个企业能够开展协同创新,与各自独立部署相比,可显著减少算力闲置、加速模型训练,并大幅降低整体成本。该设计方案为企业与云服务提供商提供了一种自主可控、高效节能的 AI 基础设施新蓝图。

这种共享式平台基于开放标准构建,并采用开源技术,消除了厂商锁定风险,支持 AI 模型与工作流程在异构环境之间无缝迁移。依托快速演进的开源生态系统,用户可获取先进工具,从而简化 AI 基础设施管理并充分提升性能和效率。

AMD Silo AI 面向 AI 的多租户计算基础设施。

这种基础设施基于 AMD Instinct GPU 构建并针对该 GPU 进行了优化,可为本地与云端部署提供稳健、高性能的多租户技术基础:

AMD Instinct MI300X/MI325X GPU,专为大规模 AI 而打造,支持硬件级分区与高带宽互连。

AMD ROCm 7 软件堆栈,支持 GPU 分区、容器化工作负载,并可与 Kubernetes、OpenShift 和 Slurm 集成。

AMD Infinity Fabric 互连技术与高级内存分区机制,可实现工作负载隔离与高吞吐性能。

经验证的合作伙伴生态系统,支持多租户 GPU 集群的编排与调度平台。

AMD AI 工作台和 AMD 资源管理器,开源企业级 AI 工具,支持通过模块化组件实现大规模 AI 部署。

由 AMD 企业级 AI 工具强力赋能

Combient 网络汇聚了北欧制造、能源与金融领域的众多企业,共同探索前沿技术。通过这一合作计划,成员企业将可以使用基于 AMD 技术构建的共享式 AI 基础设施,从而能够协同开发与部署先进 AI 解决方案,包括:

高效扩展 AI 工作负载。

快速开发和部署 AI 模型。

减少算力闲置带来的能源与资金浪费。

结合 AMD Silo AI 提供的企业级 AI 软件栈,以及专为大规模运行 AI 工作负载而打造的 AMD AI 工作台和 AMD 资源管理器,Combient 成员企业可进一步提升其 AI 部署能力。借助这些企业级 AI 工具,可直接调用重要的开源 AI 框架和生成式 AI 模型,并接入企业级 Kubernetes 平台,从而缩短从 AI 实验到大规模生产所需的时间。

Combient 副总裁兼人事与组织负责人 Jonas Wettergren 表示:“这一模式改变了我们成员企业获取和扩展 AI 算力的方式。36 家成员企业无需从零开始自行构建基础设施,而是可以接入共享的 AI 环境,从而缩短算力获取时间、降低成本,并加快实际部署进程,而不受平台限制。”

这种多租户基础设施已经带来了显著的性能提升,其中一家参与企业在使用经 ROCm 优化的 AMD Instinct MI300X GPU 后,AI 模型训练时间显著缩短,这充分展示了共享式高性能计算基础设施如何加速创新。

共享 AI 算力,推动未来发展

随着 AI 应用加速落地,算力共享将成为企业级 AI 基础设施在下一阶段的主流趋势,开启协作、主权与效率得以共存的新篇章。

AMD Silo AI 首席执行官兼联合创始人 Peter Sarlin 表示:“我们与 TensorWave 和 Combient 的合作表明,AI 算力不必被困在孤岛之中。依托基于 AMD 技术构建的强大共享式多租户集群,企业可以满足现代 AI 工作负载所需达到的性能与隔离要求,同时大规模加速创新。”

AMD Silo AI 始终致力于通过 AMD 计算平台推动 AI 前沿发展。此次合作标志着我们向前迈出了重要一步,旨在为欧洲乃至全球构建一种更安全、更具协作性、更可扩展的 AI 架构,助力企业和初创公司在不牺牲性能、控制权或可靠性的前提下加快开发速度。

TensorWave

TensorWave 是专为提升性能而打造的 AI 与 HPC 云平台。TensorWave 完全基于 AMD Instinct 系列 GPU 构建,旨在提供高带宽、内存优化的基础设施,可根据训练与推理工作负载的严苛需求实现弹性扩展。在 Magnetar、AMD Ventures 和 Nexus Venture Partners 等投资方超过 1.66 亿美元资金的支持下,TensorWave 运营着全球规模最大的纯 AMD GPU 云平台,并正在快速扩展以满足全球需求。有关更多信息,请访问 https://tensorwave.com。

Combient

Combient 是由北欧不同行业的领军企业构成的联盟,以加速数字化转型为共同目标。Combient 旗下拥有 36 家成员企业,总营收达 2,800 亿欧元,员工总数超过 140 万人。如需了解更多信息,请访问 combient.com。