Hack the Edge:开发者们在 AMD x Liquid AI 黑客马拉松上尽情释放创造力

Nov 19, 2025

超过 70 名开发者、构建者和研究人员齐聚一堂,参与由 AMD 和 Liquid AI 联合举办、聚焦边缘 AI 的快节奏创新挑战赛。这场为期两天的活动名为 Hack the Edge,在 Liquid AI 位于旧金山市中心的办公室举办,旨在让参与者们探索直接在搭载 AMD NUC 和 Ryzen AI 的台式机上运行快速、私密的小模型所能带来的全新可能性。

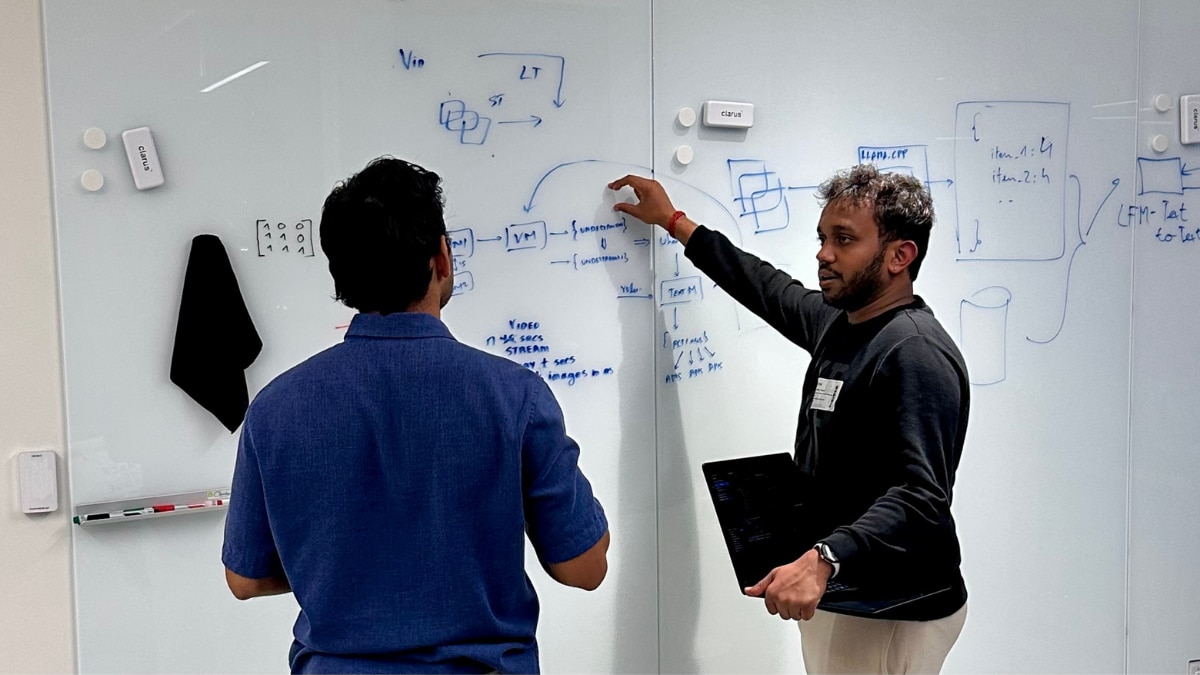

在 48 小时内,经过创意构思、代码编程、炉边谈话与现场演示,各团队最终交付了 15 个面向真实场景的智能体项目,所有项目均完全构建于运行在 ROCm 加速 AMD 硬件之上的 Liquid Foundation Models(LFM)。这场活动传递出一个清晰的信号:

混合 AI 和设备端智能并非遥不可及;它们已然到来,而且开发者们已做好构建准备。

混合 AI“遇上”专为边缘打造的硬件

此次挑战赛的主题聚焦于现代 AI 开发的一个核心问题:在本地部署场景中,能够在 AMD Ryzen AI 设备上使用 Liquid 模型构建出哪些实用的智能体应用?

Liquid AI 的 LFM 系列是一套专为快速、私有、设备端推理而打造的小型语言模型,所有项目均基于这套模型来构建。这些模型在以下工作负载中表现卓越:

- 结构化数据提取

- 函数调用

- 检索增强生成

- 翻译

- 实时多模态推理

开发者团队利用 Liquid 的 LEAP 平台、定制化工具以及最新的 LFM2、LFM2-VL、LFM Nanos 和 LFM2-Audio 模型,构建出通常需要更大模型或云规模基础设施才能实现的应用。

AMD 则展示了其开放的生态系统理念、以开发者为中心的工具链,以及覆盖云端到客户端的混合 AI 战略。借助集成到 llama.cpp 中的 AMD ROCm 软件,开发团队得以在采用 AMD Ryzen AI 技术的硬件上以超快速度运行 Liquid 模型,实现了低延迟推理与全面的本地隐私保护。

为支持快速实验和实时边缘部署,开发者们在 25 台专为设备端 AI 打造的 AMD PC 上展开了开发。所用设备包括:搭载锐龙 AI 9HX 370、Radeon 890M 显卡和 64GB RAM 的 AMD NUC,以及配备锐龙 AI 395+ 处理器和 128GB RAM 的高性能 Framework 台式机。这套硬件,加上经过优化的 Liquid Foundation Models 以及通过 llama.cpp 实现的 ROCm 加速,共同构筑了一个强大的沙盒环境,让团队可以完全在设备端完成原型设计、微调与智能体应用部署。

ROCm 驱动的 Liquid AI:基于 AMD Ryzen AI 平台实现 LLM 加速

Liquid 的 LFM 模型现已通过 AMD ROCm 软件栈完成优化,具备以下优势:

- 使用 Radeon AI 加速器充分提升性能

- 借助 ROCm 7.x 集成显著提升速度

- 通过简化工作流程,实现 llama.cpp 顺畅部署

- 完全开放的生态系统,无厂商锁定

- 针对客户需求和现代硬件优化的内核

对开发者而言,这意味着:模型更小,但性能却堪比前沿模型,且完全在设备端运行。

挑战赛主题揭晓与初步开发成果

此次黑客马拉松活动以 AMD 和 Liquid AI 的欢迎致辞拉开序幕,同时公布了挑战赛主题:利用在 AMD 硬件上本地运行的 Liquid 模型,构建一款实用的智能体应用。为激发灵感,主办方重点介绍了设备端应用场景,如会议记录器、语音听写、文档问答和以隐私保护为优先的过滤器,还介绍了边缘“盒子”概念,如安全分析、家庭健康助手和持续错误检测工具等。开发者们迅速组建团队并开启头脑风暴,到上午中段便已从想法讨论进入积极的原型设计。

第一场炉边谈话:Pau Labarta Bajo (Liquid AI) 与 Ramine Raone (AMD)

在第一场炉边谈话,来自 Liquid AI 的 Pau Labarta Bajo 与来自 AMD 的 Ramine Raone 深入探讨了设备端智能技术的未来发展。他们的对话内容丰富,涵盖从斯坦福 Hazy Research 实验室的 hipkitten 研究工作,到经过深度优化的小型模型在本地部署时为何能与更大模型相媲美等诸多话题。他们还讨论了在混合 AI 时代,“每瓦特智能”作为一项关键指标的重要性日益增长,以及为何云计算和客户端计算的融合能够加速开发者创新。两位嘉宾都强调了 AMD 与 Liquid 的合作关系如何助力在边缘实现更快的实验和更高效的应用部署。在结束时,Ramine 向身处飞速发展的 AI 浪潮中的构建者们分享了建议:日益强大的模型并非威胁,而是“能力放大器”,它们能让开发者从编码工作中解放出来,进而将更多时间用于思考。他最后提出的建议在现场引发了强烈共鸣:成为全栈、端到端的工程师,将比以往任何时候都更加重要。

第二场炉边谈话:Bryan Madden (AMD) 与 Ramin Hasani (Liquid AI)

当天下午晚些时候,AMD 全球营销主管 Bryan Madden 与 Liquid AI 联合创始人兼首席执行官 Ramin Hasani 展开了一场深度谈话,畅聊 AI 生态系统的演进历程与未来走向。Ramin 谈到 Liquid AI 的起源可以追溯到在 MIT 的研究,并介绍其神经网络架构的灵感源于模仿“蠕虫大脑”的运作机制,这种非常规思路最终带来了突破性的高效自适应神经系统。他谈到 Liquid 的愿景是打造物理 AI 的软件层,也解释了在延迟敏感和隐私至上的现实世界中,为何混合 AI 对于智能技术部署至关重要。Bryan 与 Ramin 强调了 AMD 与 Liquid 的共同使命:赋能开发者,让他们能够无阻碍地构建快速高效、私密安全的设备端智能应用。这场对话将当日的黑客松活动置于更宏大的行业叙事中,也让我们看到:开发者的创造力与开放的生态系统,正在共同塑造 AI 创新的新篇章。

边缘智能技术展示:团队开发成果

最终的演示环节展示了开发者们在短短两天时间内利用 AMD 硬件上的 Liquid 模型实现的卓越成果。项目涵盖音频、视觉、多模态智能体、自动化甚至科学计算,每一个项目都在展示快速、私密、设备端 AI 的无限可能。

- Liquid DJ 项目将 AMD NUC 变成了能够在本地识别多曲目 DJ 表演的强大 Shazam 工具,通过使用 LFM2-Audio-1.5B 检测曲目切换,并能自动生成完整的 YouTube 曲目清单。

- Liquid Audio Book 在边缘端打造了一条完整的有声读物处理流水线:LFM2-VL 负责文本提取,LFM2-Extract 负责内容精炼,LFM2-Audio 负责语音合成。无需调用云端,即可瞬间将扫描的笔记转变为高质量语音朗读。

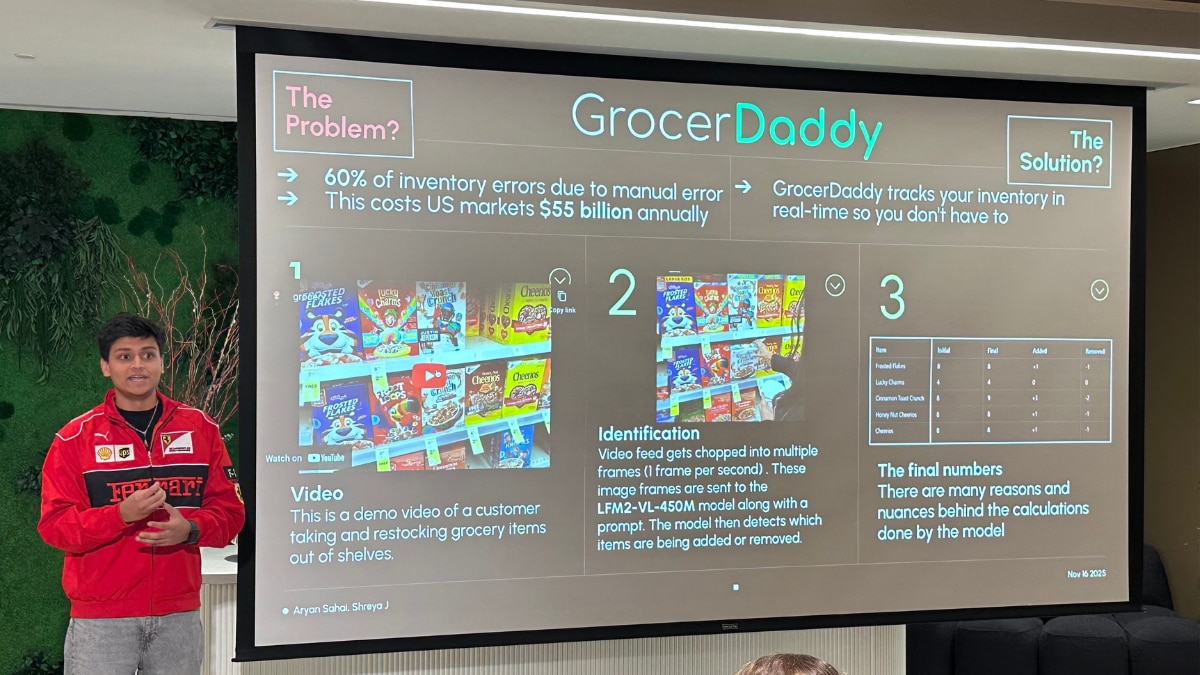

- GrocerDaddy 使用 LFM2-VL-450M 分析超市货架视频,实时检测商品添加或移除,展示了小规模多模态模型如何让零售工作流程走向自动化。

- VoltX 利用 LFM2-350M 模型构建了一款设备端电动汽车电池健康监测器,用以跟踪 SOC/SOH、衰减信号和性能趋势。该监测系统配备 FastAPI、DuckDB 和轻量级 Flask 仪表盘,可在本地实现实时指标可视化,同时通过专属 AI 助手提供个性化电池洞察分析。

- DocSpeak 就像一个本地的 NotebookLM:上传 PDF 后,使用 LFM2-Extract + LFM2-Audio 进行提取和总结并生成音频版本,轻松将冗长文档变成简短播客并保障隐私安全。

- Realtime Chatbot 展示了 LFM2-VL 模型的多模态编排能力。它构建了一个语音交互智能体,能同时理解音频输入和视频帧上下文并做出响应。

- Echo Finder 将可穿戴相机与 LFM2-2.6B、VLM 2B 和 LFM2-Audio 结合,帮助用户找回家中丢失的物品,是对老年人和视障用户极具价值的辅助应用。

- Team Monster 搭建了一条轻量级视频理解流水线,用 LFM2-VL 生成精确到每一秒的嵌入向量,在设备端实现语义片段搜索和推荐。

- LiquidSense 探索了智能家居的更多可能:使用设备端推理实现 IoT 控制、自动场景响应,以及保护隐私的异常检测。

- PharmaNeuro Predictor 将混合 AI 应用于药物研发,通过将分子特征与多模态模型相结合,以预测中枢神经系统疗效、血脑屏障穿透率和安全风险,预示着更快速、更易用的科学工作流程正在到来。

纵观全部 15 个演示项目,开发团队用行动证明了一点:有了 Liquid SLM、ROCm 加速技术和 AMD 边缘硬件的加持,开发者完全可以打造出快速高效、私密安全、富有意义和价值且可随时投入实际使用的设备端应用。

项目评审与获奖者

所有项目均围绕四个核心维度进行评审:与挑战赛主题的契合度、创意的原创性与完成度、解决方案的实用性,以及实现方案背后的技术深度。

经过一个下午的快节奏演示比拼,两支团队凭借突出的创新力、高质量实现以及突出的边缘 AI 影响力,赢得了搭载锐龙 AI 395+ 处理器的 Framework 台式机大奖。其他团队则获得了 Liquid AI 提供的奖金(总奖金池为 1 万美元)作为奖励,以表彰他们基于在 AMD Ryzen AI 平台上运行的 Liquid Foundation 模型实现的卓越应用。

活动落幕,但势头不止

回顾这个周末,最让人印象深刻的,是现场创新的速度与质量。从创意构思到成熟原型,整个开发过程非常快速。开发者们借助经 ROCm 优化的 Liquid 模型,构建起一个又一个快速高效、私密安全且功能强大的边缘应用。LFM2-VL 和 LEAP 定制化成为了全场焦点,它们为多模态智能体、视觉工具以及高度集成的工作流程提供强大支持。每一个团队都在将 SLM 推向全新领域。他们大胆实验、快速迭代,用实际行动证明:当经过优化的模型遇上强大硬件,再辅以开放的开发者生态系统,一切皆有可能。

这场黑客松活动充分彰显了 AMD 与 Liquid AI 的共同使命:

赋能开发者,让他们能够无阻碍地实现开放、高效的 AI 开发,让 AI 无处不在。

开发人员资源

AMD 持续壮大其开发者生态系统,只为让每一位开发者都能走得更远。

- 开发者资源门户 – 获取 SDK、库、文档与工具,加速 AI、HPC 和图形应用开发。

- AI@AMD X – 及时了解最新的软件发布、AI 博客、教程及新闻资讯。

- Developer Cloud – 获赠 30 天内有效、价值 100 美元的免费信用值,轻松基于 AMD Instinct GPU 启动项目,包括开展实验与基准测试。

- 开发者中心 YouTube – 浏览由工程师和社区专家带来的实操视频、演示和深度讲解。

- 开发者社区 Discord – 加入全球开发者社区,直接与同行和 AMD 专家分享反馈并交流优化心得。