Der rasche Aufstieg von Unternehmens-KI und dessen Bedeutung für Sie

Unternehmens-KI verändert mit rasanter Geschwindigkeit, wie Unternehmen wichtige Ziele erreichen: von schnellerem Umsatzwachstum bis hin zur Verbesserung der Kundenerfahrung im großen Maßstab. GenAI ist eine transformative Kraft, die die digitale Infrastruktur verändert, die Produktivität der Mitarbeiter steigert und Innovationen auf einem neuen Level ermöglicht, insbesondere wenn sie intelligent am Endpunkt bereitgestellt wird.

The Future of Work: Why IT Leaders are Turning to AI PCs

Mit KI-PCs werden Endpunkte zu leistungsstarken KI-Engines

KI-PCs sind keine einfachen Desktops oder Notebooks, sondern Hubs für Produktivität und Intelligenz der nächsten Generation:

- AI Inference, GenAI-Aufgaben und Datenanalysen direkt auf dem Gerät

- Speziell entwickelt mit KI-optimierten CPUs, GPUs und NPUs

- Unterstützen Anwendungsfälle wie Cybersicherheit, lokale Modellausführung, Automatisierung von IT-Aufgaben und Videoverarbeitung

80 %

der Unternehmen geben an, dass KI-PCs

einen schnelleren Aktualisierungszyklus für Endpunkte bieten

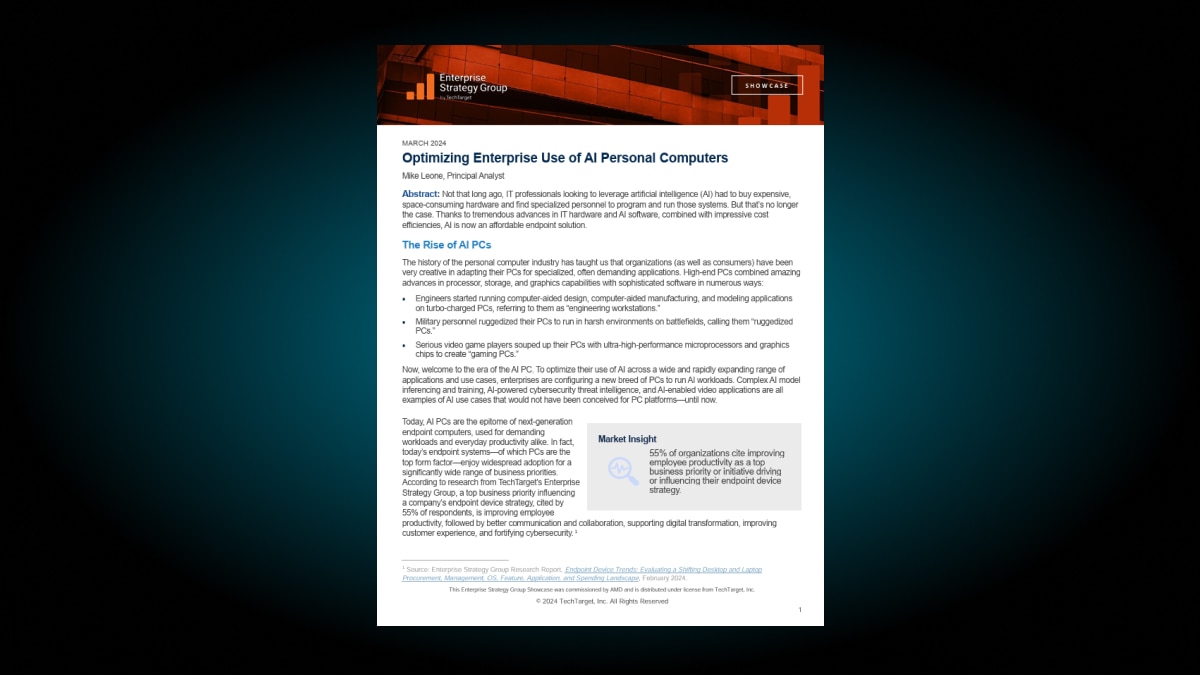

55 %

der Unternehmen nennen die Mitarbeiterproduktivität als oberste Priorität ihrer Endpunkt-Strategie

Konkrete Geschäftsvorteile: Produktivität, Sicherheit und Gesamtbetriebskosten

Investitionen in KI-PCs bieten einen messbaren Wert für zentrale Geschäftsziele:

| Ziel | Auswirkungen von KI-PCs |

| Mitarbeiterproduktivität | Personalisierte GenAI-Assistenten reduzieren die Zeit für Routineaufgaben und erhöhen die kreative Leistung. |

| Cybersicherheit | Lokale KI-Modelle verbessern Erkennung von und Reaktion auf Bedrohungen, selbst bei Air-Gap-Architektur oder niedriger Bandbreite. |

| Kostenoptimierung | Reduziert die Serverlast, verringert die Bandbreitennutzung und vermeidet eine übermäßige Abhängigkeit von abonnementbasierten KI-Diensten. |

Jetzt kommt Hybrid-KI – und mit KI-PCs lässt sie sich optimal nutzen

KI wird zunehmend in Form von hybriden Modellen bereitgestellt, die Cloud-basierte LLMS (Large Language Models) mit KI an der Edge und am Endpunkt kombinieren. Laut ESG wird heute 40 % der GenAI-Auslastung vor Ort, an der Edge oder direkt auf KI-PCs bereitgestellt. Dieser Wandel ergibt sich aus Anforderungen an geringere Latenz, höhere Datensouveränität und eine bessere Vorhersehbarkeit der Kosten.

AMD KI-Technologien wie Ryzen™, EPYC™, Instinct™ und Radeon™ unterstützen ein breites Spektrum an Strategien für Hybrid-Infrastrukturen und bieten IT-Verantwortlichen die Möglichkeit, KI-Bereitstellungen flexibel und sicher zu skalieren, ohne sich auf eine reine Cloud-Architektur zu beschränken.

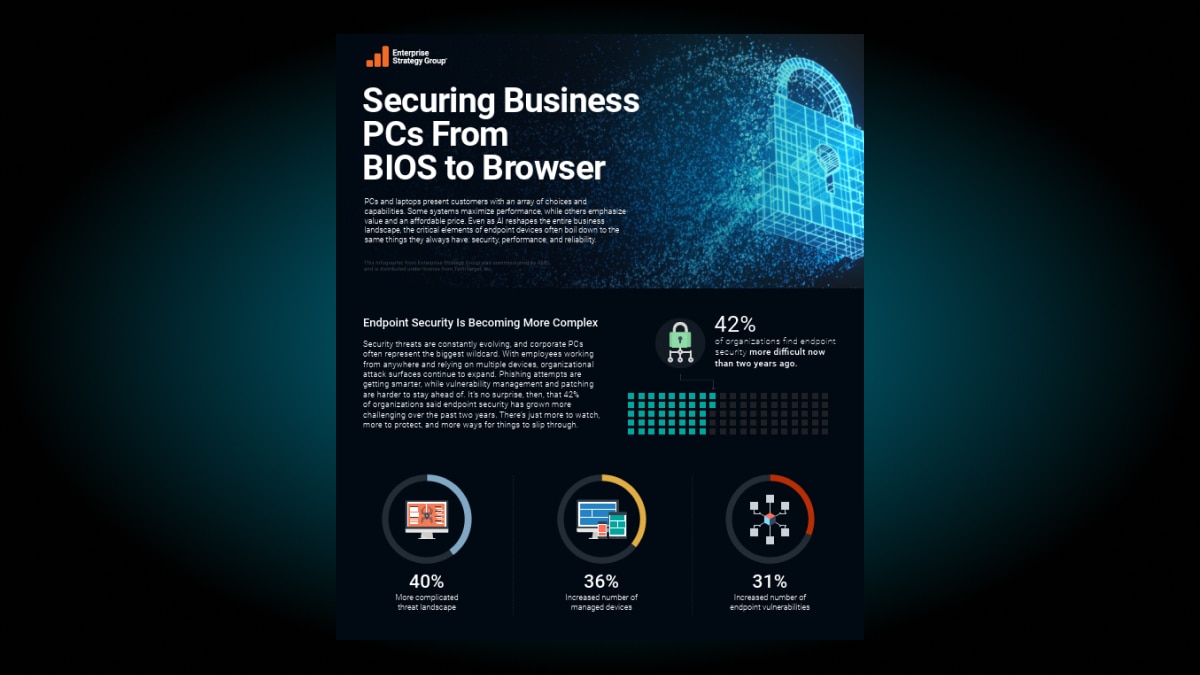

Sicherheit und Zuverlässigkeit ohne Kompromisse bei der Performance

Moderne KI-PCs sind mit Sicherheitsfunktionen der Enterprise-Klasse ausgestattet, die sie ideal für unternehmenskritische Workloads machen. AMD PRO Technologien schützen Unternehmen mit einem vollständigen Satz an Sicherheitsfunktionen, stabilen Manageability-Tools und Stabilität und Zuverlässigkeit der Enterprise-Klasse. Für Unternehmen, die in regulierten Branchen tätig sind oder sensible Daten verarbeiten, sorgt die Bereitstellung von KI an der Edge durch sichere KI-PCs für bessere Compliance, erhöhten Datenschutz und betriebliche Souveränität ohne Einbußen bei der Performance.

AMD sorgt für eine risikoarme KI-Einführung

Wenn Sie in KI-PCs mit Technologie von AMD investieren, geben Sie Ihrem Unternehmen eine zukunftssichere, offenen und kostengünstige KI-Roadmap. AMD KI-Lösungen bieten Performancevorteile, Zusammenarbeit mit allen großen OEMs und die Unterstützung offener KI-Ökosysteme.

AMD Ryzen PRO Prozessoren mit Ryzen AI sind High-Performance-Komponenten mit intelligenter Stromversorgungssteuerung für Multitasking-Auslastungen, die mit ihren Benutzern „mitgehen“ müssen. Ryzen PRO Prozessoren beinhalten eine dedizierte KI-Engine, durch die KI-PCs mit sehr hoher Performance und optimaler Kosten- und Energieeffizienz ausgeführt werden können.

Ressourcen

Unternehmens-KI-Lösungen

AMD Technologie-Blogs

Erste Schritte mit einem KI-Business-PC

Sie benötigen mehr Informationen über die gewerblichen Produkte von AMD für Ihr Unternehmen? Füllen Sie das nachfolgende Formular aus, um mit einem Experten Kontakt aufzunehmen und zu erfahren, was AMD für Ihre Organisation tun kann.

Fußnoten

- Mit Stand Mai 2023 hatte AMD die erste erhältliche dedizierte KI-Engine für Windows x86-Prozessoren. „Dedizierte KI-Engine“ ist hierbei als eine KI-Engine definiert, deren einzige Funktion das Verarbeiten von KI-Inferenzmodellen und die Teil des x86-Prozessor-Die ist. Weitere Informationen finden Sie unter: https://www.amd.com/en/technologies/xdna.html. PHX-3a

- Mit Stand Mai 2023 hatte AMD die erste erhältliche dedizierte KI-Engine für Windows x86-Prozessoren. „Dedizierte KI-Engine“ ist hierbei als eine KI-Engine definiert, deren einzige Funktion das Verarbeiten von KI-Inferenzmodellen und die Teil des x86-Prozessor-Die ist. Weitere Informationen finden Sie unter: https://www.amd.com/en/technologies/xdna.html. PHX-3a