Mandantenfähiges SDN und Virtual Networking

Verbesserte Performance für anspruchsvolle KI-Anwendungen durch Bereitstellung von grundlegendem SDN.

Front-End-Netzwerke für moderne Rechenzentren

Die AMD Pensando™ DPU-Technologie wurde von einigen der branchenweit größten Anbieter von Unternehmens- und Cloud-Services über Produktgenerationen hinweg übernommen. Die AMD Pensando DPUs wurden als Front-End-Netzwerklösung in einigen der größten Hyperscale-Rechenzentren weithin übernommen, validiert und getestet.

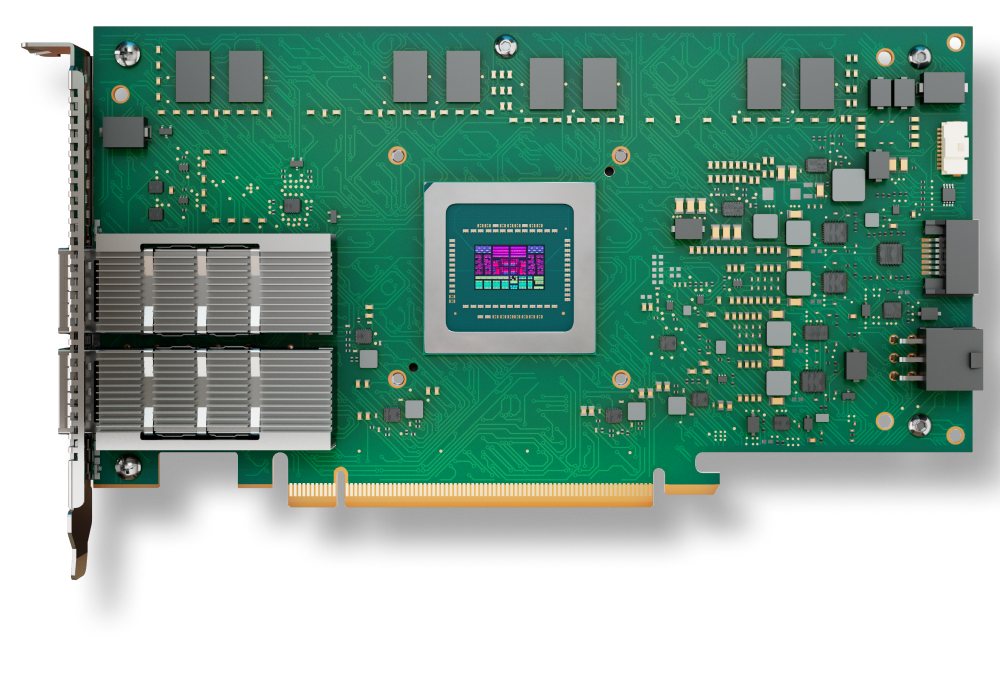

Die AMD Pensando™ Salina 400 DPU ist vollständig P4-programmierbar und optimiert für Latenz, Jitter und Energiebedarf auf Minimalniveau. Die DPU der dritten Generation von AMD Pensando liefert unglaubliche Energieeffizienz bei gleichzeitiger Erhöhung des Durchsatzes für P4-Pipelines und ermöglicht zugleich Softwarekompatibilität mit vorherigen AMD Pensando™ DPUs, was den Kunden die Übernahme erleichtert.

Funktionen

Vorteile

5-fache SDN-Performance2

Multi-Service

Zukunftsbereit

100-fache Verbesserung der CPS-Performance3

Kosteneinsparungen

Bare-Metal und VSI

Einsparungen bei Gesamtbetriebskosten4

Regulierte Branchen

Einsparungen bei Gesamtbetriebskosten in Höhe von 65 Mio. $5

Erfahren Sie, wie die AMD Pensando™ DPU-Technologie das Front-End-Netzwerk für moderne Rechenzentren transformieren kann. Entdecken Sie die komplette Suite von Netzwerklösungen, die für moderne High-Performance-Rechenzentren entwickelt wurden.