Versal™ AI Core 시리즈

AMD Versal AI Core 시리즈는 탁월한 컴퓨팅 성능을 제공하는 AI Engine을 통해 혁신적인 AI 추론 및 무선 가속을 제공합니다. Versal 포트폴리오에서 가장 뛰어난 컴퓨팅을 제공하는 Versal AI Core Adaptive SoC용 애플리케이션에는 데이터 센터 컴퓨팅, 무선 빔포밍, 동영상 및 이미지 처리, 무선 테스트 장비가 포함됩니다.

5G 셀룰러, 데이터 센터, 자동차, 산업 등 역동적이고 진화 중인 많은 시장에서 애플리케이션은 전력 효율을 유지하면서 컴퓨팅 가속화를 촉진하고 있습니다. 무어의 법칙과 데너드 스케일링이 더 이상 기존의 추세를 따르지 않기 때문에 차세대 실리콘 노드로 이동하는 것만으로는 이전 세대에서와 같이 더 낮은 전력과 비용으로 더 나은 성능을 얻을 수 없습니다.

무선 빔포밍 및 머신 러닝 추론과 같은 차세대 애플리케이션의 이러한 비선형 수요 증가에 대응하여 AMD는 AMD Versal™ 아키텍처의 일부로 혁신적인 처리 기술인 AI Engine을 개발했습니다.

AI Engine은 여러 개의 AI 엔진 타일로 구성된 2D 어레이로 설계되어 있으며, Versal 포트폴리오 전반에 걸쳐 수십 개에서 수백 개에 이르는 AI 엔진을 단일 디바이스에 활용하는 확장성이 매우 뛰어난 솔루션을 가능하게 하여 광범위한 애플리케이션의 컴퓨팅 요구를 충족할 수 있습니다. 장점은 다음과 같습니다.

고성능 DSP 애플리케이션의 경우 AI 엔진 코딩에 다음 방법을 사용할 수 있습니다(자세한 내용은 AMD Vitis™ AI Engine DSP 설계 참조).

각 AI Engine 타일은 머신 러닝 및 고급 신호 처리 애플리케이션에 최적화된 매우 긴 명령어(VLIW), 단일 명령 다중 데이터(SIMD) 벡터 프로세서로 구성됩니다. AI Engine 프로세서는 최대 1.3GHz로 작동하며 매우 효율적이고 처리율이 높은 저지연율 기능을 구현할 수 있습니다.

VLIW 벡터 프로세서뿐 아니라 각 타일에도 필요한 명령을 저장하는 프로그램 메모리, 데이터, 가중치, 활성화, 계수를 저장하는 로컬 데이터 메모리 및 다양한 유형의 데이터 통신을 처리하기 위한 RISC 스칼라 프로세서와 다양한 상호 연결 모드가 포함되어 있습니다.

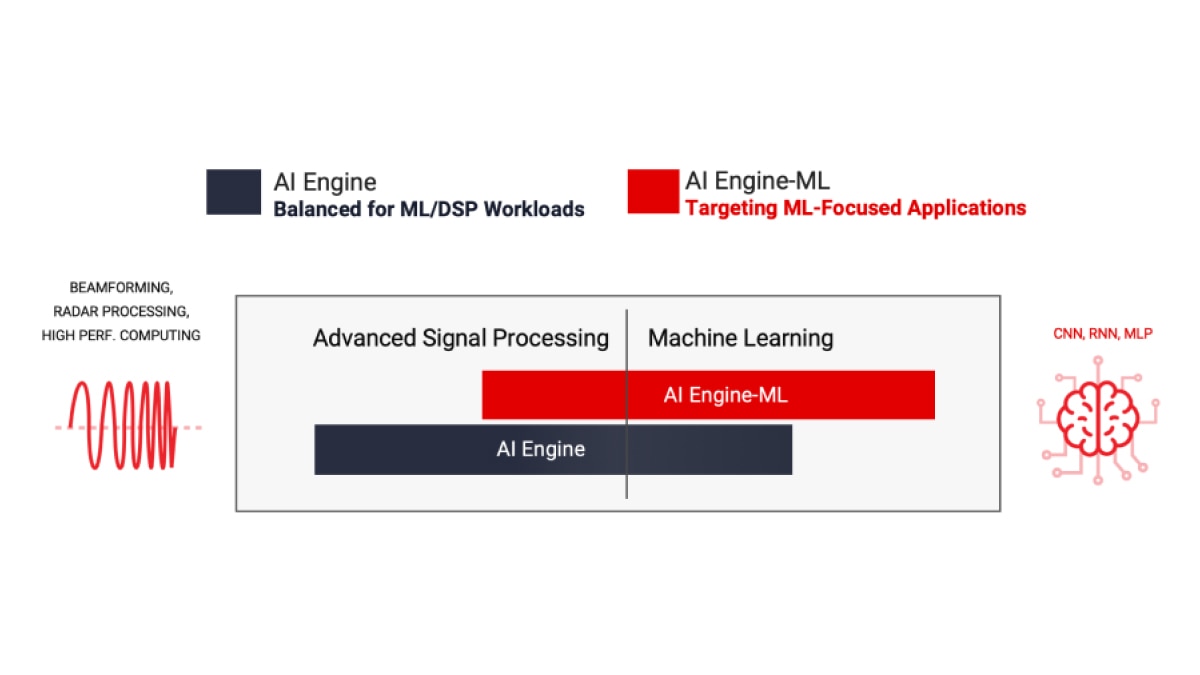

AMD는 두 가지 유형의 AI Engine을 제공합니다. AIE 및 AIE-ML(머신 러닝용 AI Engine)은 모두 이전 세대 FPGA에 비해 상당히 향상된 성능을 제공합니다. AIE는 ML 추론 애플리케이션 및 빔포밍, 레이더 및 대량의 필터링 및 변환이 필요한 기타 워크로드와 같은 고성능 DSP 신호 처리 워크로드를 포함하여 보다 균형 잡힌 워크로드 집합을 가속화합니다. 향상된 AI 벡터 확장과 AI Engine 어레이 내에 공유 메모리 타일이 도입됨에 따라 AIE-ML은 ML 추론 중심 애플리케이션에서 AIE보다 우수한 성능을 제공하며, AIE는 특정 유형의 고급 신호 처리에 대해 AIE-ML보다 더 나은 성능을 제공할 수 있습니다.

AIE는 ML 추론 애플리케이션 및 빔포밍, 레이더, FFT 및 필터와 같은 고급 신호 처리 워크로드를 포함한 균형 잡힌 워크로드 집합을 가속화합니다.

자세한 내용은 AMD Versal AI Engine 아키텍처 매뉴얼을 참조하세요.

*BFLOAT16은 FP32 벡터 프로세서를 사용하여 구현되었습니다.

AI Engine-ML 아키텍처는 머신 러닝에 최적화되어 컴퓨팅 코어와 메모리 아키텍처를 모두 향상합니다. ML과 고급 신호 처리 모두에 사용할 수 있는 이 최적화된 타일은 ML에 중점을 둔 애플리케이션 향상을 위해 INT32와 CINT32 지원(레이더 처리에서 공통)을 강조하지 않습니다.

AIE-ML은 두 가지 버전으로 제공됩니다. AIE-ML은 AIE에 비해 컴퓨팅이 두 배이고, AIE-MLv2는 AIE-ML에 비해 컴퓨팅이 두 배입니다. AIE-MLv2는 스트림 상호 연결 간에 대역폭을 추가합니다.

**AIE-ML FP32 지원을 위한 SW 에뮬레이션

AI Engine은 프로그래밍 가능한 로직 및 처리 시스템과 함께 Versal Adaptive SoC에서 긴밀하게 통합된 이종 아키텍처를 구성합니다. 이는 광범위한 애플리케이션 및 워크로드의 요구에 동적으로 대응하도록 하드웨어 및 소프트웨어 수준에서 모두 변경할 수 있습니다.

처음부터 기본적으로 소프트웨어 프로그래밍이 가능하도록 설계된 Versal 아키텍처는 모든 구성 요소와 주요 인터페이스를 원활하게 통합할 수 있는 유연한 멀티 테라비트/초 프로그래밍 가능 네트워크 온 칩(NOC)을 갖추고 있어 부팅 시 플랫폼을 사용할 수 있으며 소프트웨어 개발자, 데이터 과학자 및 하드웨어 개발자 모두가 쉽게 프로그래밍할 수 있습니다.

무선 처리에서 클라우드, 네트워크 및 에지의 머신 러닝에 이르는 이종 워크로드를 위한 AI Engine

데이터 센터 컴퓨팅

이미지 및 동영상 분석은 데이터 센터에서 데이터가 폭발적으로 증가하는 이유 중 하나입니다. 이러한 워크로드의 컨볼루션 신경망(CNN) 특성으로 인해 많은 양의 계산이 필요하며 계산 규모가 테라OPS에 달하는 경우가 많습니다. AI Engine은 이러한 계산 밀도를 비용 효율적이고 전력 효율적인 방식으로 제공하도록 최적화되었습니다.

5G 무선 처리

5G는 초저지연율을 통해 전례 없는 처리율을 제공할 수 있으므로 신호 처리를 상당히 증가시켜야 합니다. AI Engine은 네트워크 용량을 늘리기 위해 대규모 MIMO 패널에 사용되는 정교한 빔포밍 기법과 같이 낮은 전력으로 무선 장치(RU) 및 분산 장치(DU)에서 이러한 실시간 신호 처리를 실행할 수 있습니다.

ADAS 및 자동 주행

CNN은 시각적 이미지 분석에 가장 일반적으로 적용되는 심층 순방향 인공 신경망의 한 종류입니다. CNN은 자율 주행 차량에서 비디오 감시에 이르기까지 모든 분야에서 컴퓨터가 사용됨에 따라 필수 요소로 자리 잡았습니다. AI Engine은 열 범위가 좁은 소형 폼 팩터에 필요한 컴퓨팅 밀도와 효율성을 제공합니다.

항공우주 및 국방

강력한 벡터 기반 DSP 엔진과 AI 엔진을 작은 폼 팩터로 병합하면 위상 배열 레이더, 조기 경보(EW), 군사 통신(MILCOM) 및 무인 차량을 비롯한 다양한 시스템을 A&D에 적용할 수 있습니다. 다중 미션 페이로드를 위한 신호 처리, 신호 컨디셔닝 및 AI 추론에 이르는 이종 워크로드를 지원하는 AI 엔진은 이러한 미션 크리티컬 시스템의 공격적인 크기, 무게 및 전력(WSaP) 요구 사항을 충족하는 컴퓨팅 효율성을 제공합니다.

산업

로봇 공학 및 머신 비전을 포함한 산업 응용 분야는 센서 융합을 AI/ML과 결합하여 정보 소스 경계 및 근처에서 데이터 처리를 수행합니다. AI Engine은 환경의 불확실성에도 불구하고 이러한 실시간 시스템의 성능과 신뢰도를 향상합니다.

무선 테스트 장비

실시간 DSP는 무선 통신 테스트 장비에서 광범위하게 사용됩니다. AI Engine 아키텍처는 디지털 프런트 엔드부터 빔포밍 및 베이스밴드에 이르기까지 5G를 비롯한 모든 유형의 프로토콜 구현을 처리하는 데 적합합니다.

헬스케어

AI Engine을 활용하는 헬스케어 응용 분야에는 의료용 초음파를 위한 고성능 병렬 빔포머, CT 스캐너를 위한 후방 투영, MRI 기계의 이미지 재구성 부하 분산, 다양한 임상 및 진단 애플리케이션에서의 보조 진단 등이 포함됩니다.

AI Engine은 처음부터 소프트웨어 프로그래밍 및 하드웨어 조정이 가능하도록 제작되었습니다. 개발자가 몇 분 만에 컴파일하고 다양한 마이크로 아키텍처를 빠르게 탐색할 수 있는 기능을 통해 이러한 컴퓨팅 엔진의 성능을 실현할 수 있는 두 가지 설계 흐름이 존재합니다. 이 두 설계 흐름은 다음과 같이 구성됩니다.

또한 AI Engine 어레이는 리소스 및 전력에 최적화된 방식으로 고성능 DSP 기능을 구현할 수 있습니다. AI 엔진을 FPGA 패브릭 리소스와 함께 사용하면 고성능 DSP 애플리케이션을 매우 효율적으로 구현할 수 있습니다. AMD Vitis 도구 흐름을 사용하여 DSP 애플리케이션용 AI Engine의 하드웨어 가속 기능을 활용하는 방법을 알아보세요. AMD Vitis AI Engine DSP 설계

AMD는 Vitis 가속화 라이브러리를 통해 다음과 같은 기능을 지원하는 사전 구축된 커널을 제공합니다.

소프트웨어 및 하드웨어 개발자는 벡터 프로세서 기반 AI 엔진을 직접 프로그래밍하고 적절한 경우 C/C++ 코드로 사전 구축된 라이브러리를 호출할 수 있습니다.

AI 데이터 과학자들은 PyTorch 또는 TensorFlow와 같은 익숙한 프레임워크 환경에서 AI Engine을 직접 프로그래밍하지 않고도 Vitis AI를 통해 사전 구축된 ML 오버레이를 호출할 수 있습니다.

라이브러리는 오픈 소스이며 GitHub(https://github.com/Xilinx/Vitis_Libraries)에서 제공됩니다.

AI Engine 아키텍처는 데이터 흐름 기술을 기반으로 합니다. 프로세싱 요소는 10개에서 100개의 타일 어레이로 이루어져 있어 컴퓨팅 유닛에 걸쳐 단일 프로그램을 생성합니다. 설계자가 이러한 타일에 병렬화를 지정하기 위해 명령어를 포함시키는 것은 귀찮은 작업인 데다 거의 불가능합니다. 이러한 어려움을 극복하기 위해 AI Engine 설계는 단일 커널 개발 및 후속 적응형 데이터 흐름(ADF) 그래프 생성이라는 두 단계로 이루어집니다. 이 과정에서 여러 개의 커널이 전체 애플리케이션으로 연결됩니다.

Vitis 통합 IDE는 C/C++ 프로그래밍 코드와 ADF 그래프 설계를 사용하여 AI 엔진 커널 개발을 지원하는 단일 IDE 플랫폼을 제공합니다. 특히 설계자는 다음을 수행할 수 있습니다.

기본적으로 단일 커널은 단일 AI Engine 타일에서 실행됩니다. 그러나 동일한 AI Engine 타일에서 여러 커널을 실행할 수 있어 애플리케이션이 허용하는 처리 시간을 공유할 수 있습니다.

개념적 예시는 다음과 같습니다.

Vitis 통합 IDE 내 AI Engine 설계는 설계의 모든 측면을 시뮬레이션, 하드웨어 에뮬레이션, 디버그 및 배포가 가능한 통합 흐름으로 결합하는 더 큰 전체 시스템에 포함될 수 있습니다.

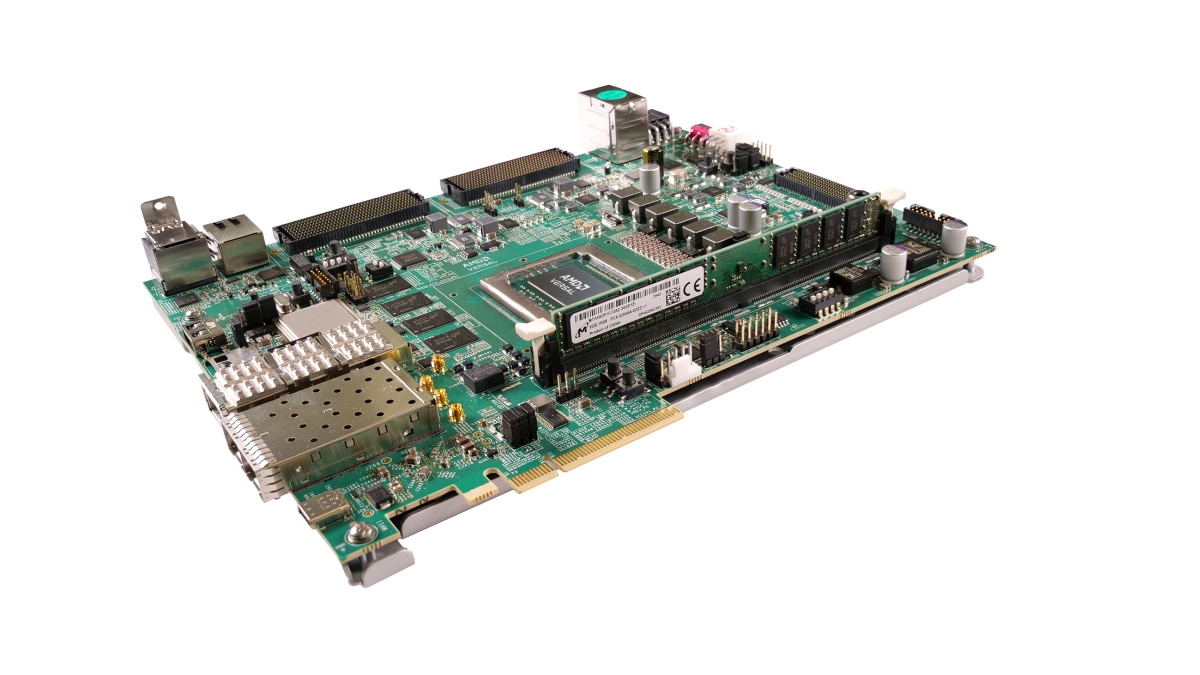

Versal AI Edge VE2802 Adaptive SoC가 장착된 VEK280 평가 키트는 AIE-ML 및 DSP 하드웨어 가속 엔진과 다양한 고속 연결 옵션을 제공합니다. 이 키트는 자동차, 비전, 항공우주 및 방위, 산업, 과학 및 의료 등의 시장에서 ML 추론 응용 분야에 최적화되어 있습니다.

설계자는 VCK190 평가 키트를 통해 AI 및 DSP 엔진을 사용하여 현재 서버급 CPU에 대비 100배 이상 뛰어난 컴퓨팅 성능을 제공할 수 있는 솔루션을 개발할 수 있습니다. Versal AI Core 시리즈 VC1902 디바이스는 광범위한 연결 옵션과 표준화된 개발 흐름을 통해 클라우드, 네트워크 및 에지 애플리케이션을 위한 Versal 포트폴리오에서 가장 높은 AI 추론 및 신호 처리 처리율을 제공합니다.

AMD Vitis 통합 소프트웨어 플랫폼은 하드웨어 가속화 기술을 사용하는 포괄적인 핵심 개발 키트 및 라이브러리를 제공합니다.

Vitis GitHub 및 AI Engine 개발 리포지토리를 방문하여 다양한 AI Engine 튜토리얼에 액세스하고 기술 기능 및 설계 방법론에 대해 자세히 알아보세요.

AI Engine 도구, 즉 컴파일러와 시뮬레이터는 모두 Vitis IDE 내에 통합되어 있으며 추가 전용 라이선스가 필요합니다. AI Engine 도구 및 라이선스에 액세스하는 방법에 대한 자세한 내용은 현지 AMD 영업 담당자에게 문의하거나 영업팀 문의 양식을 참고하세요.

AMD Vitis 모델 컴포저는 Simulink® 및 MATLAB® 환경에서 신속한 설계 탐색을 지원하는 모델 기반 설계 도구입니다. 시스템 수준에서 AI 엔진 ADF 그래프 개발 및 테스트를 용이하게 하여 사용자가 동일한 시뮬레이션에서 RTL 및 HLS 블록을 AI 엔진 커널 및/또는 그래프와 통합할 수 있도록 지원합니다. DSP 엔지니어는 Simulink 및 MATLAB 도구의 신호 생성 및 시각화 기능을 활용하여 친숙한 환경에서 설계 및 디버깅을 수행할 수 있습니다. Vitis 모델 컴포저와 함께 Versal AI Engine을 사용하는 방법을 알아보려면 AI Engine 리소스 페이지를 방문하세요.

Versal AI Core 시리즈를 기반으로 하는 VCK190 키트는 설계자가 AI 엔진 및 DSP 엔진을 사용하는 솔루션을 개발할 수 있도록 지원합니다. 평가 키트에는 설계를 시작하는 데 필요한 모든 것이 들어 있습니다.

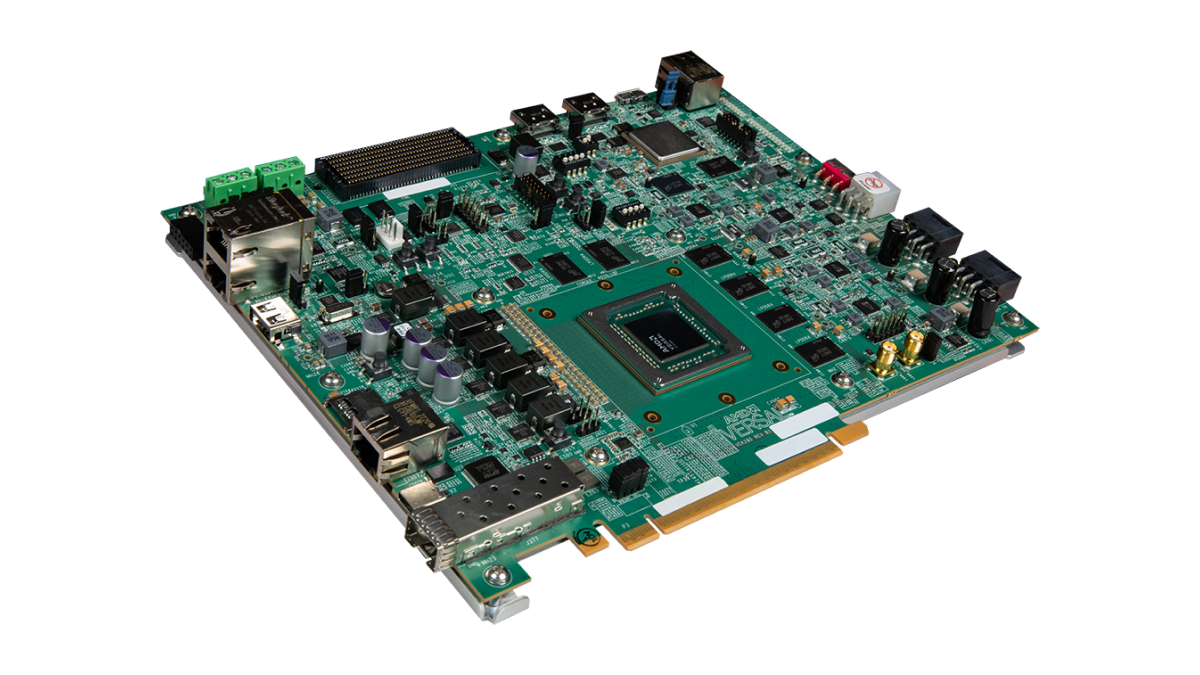

또한 데이터 센터에서 처리율이 높은 AI 추론을 위해 구축된 AI 엔진이 탑재된 Versal AI Core 디바이스를 특징으로 하는 PCIe® 기반 VCK5000 개발 카드도 사용할 수 있습니다.

AIE-ML 개발을 위해 Versal AI Edge 시리즈를 기반으로 고안된 VEK280 평가 키트는 DSP 및 ML 애플리케이션 개발자를 지원합니다.

AMD 교육 및 학습 리소스는 다음 Versal Adaptive SoC 개발 프로젝트에서 완전한 생산성을 발휘하는 데 필요한 실용적인 기술과 기본 지식을 제공합니다. 교육 과정은 다음과 같습니다.

솔루션 계획에서 시스템 통합 및 검증에 이르기까지 AMD는 사용자 설계의 생산성을 극대화하기 위해 광범위한 Versal Adaptive SoC 문서 목록을 맞춤형으로 제공합니다. Versal Adaptive SoC 설계 프로세스 허브를 방문하여 설계 요구 사항에 맞는 최신 콘텐츠를 얻고 AI Engine 기능 및 설계 방법론을 살펴보세요.

최신 뉴스와 업데이트를 받으려면 적응형 SoC 및 FPGA 알림 목록에 등록하세요.